Formation Fine-tuning Expert : QLoRA, Axolotl & MLOps

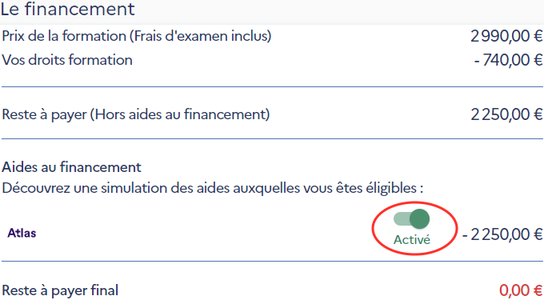

| 2290€ HT / personne |

| 3 jours (21 heures) |

Présentation

Fine-tuning Expert : QLoRA, Axolotl & MLOps vous apprend à adapter un LLM à vos données métier avec un coût GPU maîtrisé. Vous repartez avec une chaîne reproductible pour entraîner, évaluer et déployer un modèle spécialisé (support client, extraction, classification, RAG).

La formation vise une montée en compétence opérationnelle sur QLoRA (quantification + LoRA), l’orchestration d’entraînements via Axolotl, et les bonnes pratiques MLOps pour industrialiser vos itérations. Nous couvrons la préparation des datasets (format, nettoyage, prompts), le choix des hyperparamètres, la gestion mémoire, et les stratégies d’évaluation (benchmarks, tests métier).

L’approche est centrée sur des ateliers guidés et des démos reproductibles : lancement d’un run, suivi des métriques, comparaison de checkpoints, export et packaging. Livrables : scripts Axolotl, pipeline de data prep, rapport d’évaluation, modèle LoRA/merged et procédure de déploiement.

Comme toutes nos formations, celle-ci vous présentera la dernière version stable de la technologie et ses nouveautés.

Objectifs

- Préparer un dataset d’instruction tuning et définir une stratégie de prompts.

- Configurer et exécuter un fine-tuning QLoRA avec Axolotl.

- Optimiser consommation GPU (quantification, batch, gradient checkpointing).

- Évaluer et comparer des runs (métriques, tests métier, régression).

- Industrialiser avec des pratiques MLOps (versioning, traçabilité, déploiement).

Public visé

- Ingénieurs ML / Data Scientists

- ML Engineers / MLOps Engineers

- Développeurs Python travaillant sur des LLMs

- Responsables techniques IA

Pré-requis

- Bon niveau en Python (packages, environnements, scripts)

- Notions solides de deep learning (transformers, entraînement)

- Pratique de Git et du terminal

- Compréhension des formats de données (JSON/JSONL) et du nettoyage

Pré-requis techniques

- Machine Linux/macOS/Windows avec WSL2 recommandé

- RAM 16 Go minimum (32 Go conseillé)

- GPU NVIDIA recommandé : 12 Go VRAM minimum (24 Go conseillé), CUDA installé

- Python 3.10+, conda/venv, PyTorch, Hugging Face, Axolotl, bitsandbytes

Programme de formation Fine-tuning Expert : QLoRA, Axolotl & MLOps

[Jour 1 – Matin]

Fondamentaux du fine-tuning LLM et stratégie d’adaptation (SFT, DPO, LoRA)

- Clarifier les objectifs : assistant, extraction, classification, génération contrôlée

- Choisir l’approche : SFT vs DPO vs RLHF (quand et pourquoi)

- Comprendre LoRA : rang, alpha, modules cibles, impact sur qualité et coût

- Préparer l’environnement GPU : CUDA, drivers, VRAM, bfloat16/fp16, contraintes multi-GPU

- Atelier pratique : Diagnostic d’un cas d’usage et choix d’une stratégie de fine-tuning.

[Jour 1 – Après-midi]

QLoRA en pratique : quantification, mémoire et stabilité d’entraînement

- Principe QLoRA : 4-bit (NF4), double quantization, compute dtype

- Réglages clés : batch size, gradient accumulation, sequence length, packing

- Stabilité : gradient checkpointing, clipping, warmup, scheduler, seed et reproductibilité

- Mesures et suivi : loss, perplexity, overfitting, échantillons de génération

- Atelier pratique : Lancer un premier fine-tuning QLoRA sur un modèle open-source et analyser les métriques.

[Jour 2 – Matin]

Axolotl : configuration, datasets et pipelines SFT

- Structure d’un projet Axolotl : YAML, modèles, datasets, sorties et checkpoints

- Formats de données : instruction-following, chat templates, JSONL, champs système/utilisateur/assistant

- Pré-traitement : nettoyage, déduplication, filtrage, équilibrage, split train/val

- Optimisations : packing, flash-attn, paged optimizers, gestion VRAM/throughput

- Atelier pratique : Construire un dataset SFT et exécuter un run Axolotl reproductible.

[Jour 2 – Après-midi]

Alignement et qualité : évaluation, DPO et tests de robustesse

- Définir un protocole d’évaluation : jeux de tests, prompts fixes, critères métier

- Mesures : win-rate, exact match, toxicité, hallucinations, latence et coût

- Introduction DPO : données de préférences, paires chosen/rejected, pièges courants

- Tests de robustesse : jailbreaks, données hors-distribution, régressions fonctionnelles

- Atelier pratique : Mettre en place une évaluation automatique + un run DPO sur un petit jeu de préférences.

[Jour 3 – Matin]

MLOps du fine-tuning : traçabilité, versioning et gouvernance

- Traçabilité des expériences : hyperparamètres, seeds, artefacts, logs et comparaison de runs

- Versioning : données, prompts, modèles, adapters LoRA, config Axolotl et dépendances

- Gestion des secrets et conformité : PII, licences datasets/modèles, auditabilité

- Stratégies de promotion : baseline → candidate → staging → production avec critères de sortie

- Atelier pratique : Mettre en place un workflow de versioning (données + modèle + config) et une checklist de release.

[Jour 3 – Après-midi]

Packaging, déploiement et monitoring : de l’adapter LoRA à l’inférence

- Choisir le mode de livraison : adapters LoRA vs merge, quantification d’inférence, formats (safetensors)

- Servir le modèle : paramètres d’inférence (température, top_p), limites de contexte, batching

- CI/CD : tests de non-régression, évaluation avant merge, build d’artefacts et publication interne

- Monitoring : dérive, qualité perçue, feedback utilisateurs, alerting sur coûts/latence/erreurs

- Atelier pratique : Construire un pipeline de release avec tests + déployer un endpoint d’inférence et définir des métriques de suivi.

Pour aller plus loin

Formation ChatGPT

Formation Mixtral

Formation Python Data Analyst

Langues et Lieux disponibles

Langues

- Français

- Anglais / English

Lieux

-

France entière

- Paris

- Lille

- Reims

- Lyon

- Toulouse

- Bordeaux

- Montpellier

- Nice

- Sophia Antipolis

- Marseille

- Aix-en-Provence

- Nantes

- Rennes

- Strasbourg

- Grenoble

- Dijon

- Tours

- Saint-Étienne

- Toulon

- Angers

-

Belgique

- Bruxelles

- Liège

-

Suisse

- Genève

- Zurich

- Lausanne

-

Luxembourg

Témoignages

⭐⭐⭐⭐⭐ 4,8/5 sur Google My Business. Vous aussi, partagez votre expérience !

Afficher tous les témoignages

⭐⭐⭐⭐⭐ 4,8/5 sur Google My Business. Vous aussi, partagez votre expérience !

Noter la formation

| 2290€ HT / personne |

| 3 jours (21 heures) |

UNE QUESTION ? UN PROJET ? UN AUDIT DE CODE / D'INFRASTRUCTURE ?

Pour vos besoins d’expertise que vous ne trouvez nulle part ailleurs, n’hésitez pas à nous contacter.

ILS SE SONT FORMÉS CHEZ NOUS