Formation deep Learning avec PyTorch

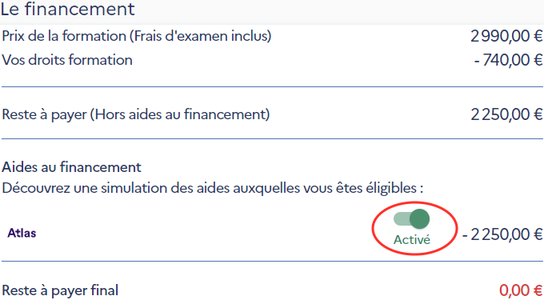

| 2 290€ HT / personne |

| 3 jours (21 heures) |

Présentation

PyTorch est devenu le framework de référence pour la recherche et l’industrie en Intelligence Artificielle. Sa flexibilité, son approche par graphe dynamique et son intégration native avec Python en font l’outil privilégié pour concevoir des architectures de Deep Learning innovantes.

Notre formation Deep Learning avec PyTorch vous permettra de maîtriser les concepts fondamentaux des réseaux de neurones, de la manipulation des Tensors à la création d’architectures complexes comme les CNN ou les Transformers.

Vous apprendrez à structurer vos phases d’entraînement, à optimiser la convergence de vos modèles et à utiliser des outils avancés pour le débogage et la visualisation. La formation met l’accent sur la pratique pour vous rendre autonome dans la résolution de problématiques concrètes de vision par ordinateur ou de traitement du langage.

À l’issue de la formation, vous serez en mesure de concevoir, d’entraîner et de déployer des modèles de Deep Learning performants, tout en adoptant les meilleures pratiques de développement liées à l’écosystème PyTorch.

Comme toutes nos formations, celle-ci vous présentera la dernière version stable de la technologie et ses nouveautés.

Objectifs

- Construire des réseaux de neurones

- Entraîner et évaluer des modèles

- Optimiser et déboguer les architectures

- Déployer des modèles DL

Public visé

- Data scientists

- AI engineers

Pré-requis

- Connaissances en Python, ML et mathématiques

Pré-requis logiciels

- 8 Go de RAM au minimum, 16 Go recommandés

- Accès à un GPU (via Google Colab, Kaggle ou machine locale avec CUDA)

- Environnement Python avec Jupyter Notebook ou VS Code

Programme de notre formation Deep Learning avec PyTorch

[Jour 1 – Matin]

Fondamentaux de PyTorch et Tensors

- Comprendre l’écosystème PyTorch et ses avantages

- Manipulation des Tensors : création, opérations et broadcasting

- Le moteur d’autodifférenciation : Autograd

- Gestion des périphériques (CPU vs GPU/CUDA)

- Introduction au module torch.nn

- Atelier pratique : Implémentation d’une régression linéaire “from scratch” avec Autograd.

[Jour 1 – Après-midi]

Construction de réseaux de neurones (MLP)

- Structure d’un Module PyTorch : méthode __init__ et forward

- Fonctions d’activation (ReLU, Sigmoid, Softmax)

- Initialisation des poids et biais

- Les couches denses (Linear layers)

- Architecture des réseaux de neurones multi-couches

- Atelier pratique : Création d’un Perceptron Multicouche pour la classification de données tabulaires.

Entraînement et Boucles d’optimisation

- Choix des fonctions de coût (Loss Functions)

- Algorithmes d’optimisation (SGD, Adam, RMSprop)

- Cycle d’entraînement : Forward pass, Loss calculation, Backward pass, Optimizer step

- Suivi des métriques de performance

- Gestion des DataLoaders et Datasets

- Atelier pratique : Entraînement complet d’un modèle sur le dataset MNIST.

[Jour 2 – Matin]

Deep Learning pour la Vision (CNN)

- Principes des réseaux de neurones convolutifs (CNN)

- Couches de convolution, pooling et dropout

- Architectures célèbres (ResNet, VGG) et Transfer Learning

- Augmentation de données avec torchvision

- Fine-tuning de modèles pré-entraînés

- Atelier pratique : Classification d’images avec un modèle CNN personnalisé et pré-entraîné.

[Jour 2 – Après-midi]

Optimisation et Régularisation

- Prévenir le sur-apprentissage (Overfitting)

- Techniques de Batch Normalization

- Stratégies de Learning Rate Scheduling

- Utilisation de TensorBoard ou Weights & Biases pour la visualisation

- Sauvegarde et chargement de modèles (state_dict)

- Atelier pratique : Optimisation d’un modèle complexe et visualisation de la convergence.

Débogage et Profiling

- Identifier les problèmes de gradients (vanishing/exploding)

- Vérification des dimensions des Tensors

- Utilisation des hooks PyTorch pour inspecter les couches

- Profiling des performances mémoire et calcul

- Atelier pratique : Session de débogage sur une architecture volontairement défaillante.

[Jour 3 – Matin]

Introduction aux modèles Séquentiels et Transformers

- Réseaux récurrents (RNN, LSTM, GRU)

- Mécanismes d’Attention

- Introduction à l’architecture Transformer

- Utilisation de la bibliothèque Hugging Face avec PyTorch

- Applications au NLP (Traitement du langage naturel)

- Atelier pratique : Analyse de sentiments ou génération de texte simple.

[Jour 3 – Après-midi]

Déploiement et Industrialisation

- Optimisation des modèles pour l’inférence

- Conversion vers TorchScript et ONNX

- Introduction à TorchServe pour le service de modèles

- Quantification et élagage (Pruning) de modèles

- Bonnes pratiques MLOps avec PyTorch

- Atelier pratique : Export d’un modèle et simulation d’une API d’inférence.

Projet de synthèse final

- Définition d’une problématique métier

- Choix et conception de l’architecture

- Entraînement optimisé et évaluation rigoureuse

- Présentation des résultats et pistes d’amélioration

- Atelier pratique : Challenge final de groupe sur un dataset réel.

Langues et Lieux disponibles

Langues

- Français

- Anglais / English

Lieux

-

France entière

- Paris

- Lille

- Reims

- Lyon

- Toulouse

- Bordeaux

- Montpellier

- Nice

- Sophia Antipolis

- Marseille

- Aix-en-Provence

- Nantes

- Rennes

- Strasbourg

- Grenoble

- Dijon

- Tours

- Saint-Étienne

- Toulon

- Angers

-

Belgique

- Bruxelles

- Liège

-

Suisse

- Genève

- Zurich

- Lausanne

-

Luxembourg

Témoignages

⭐⭐⭐⭐⭐ 4,8/5 sur Google My Business. Vous aussi, partagez votre expérience !

vAfficher tous les témoignages

⭐⭐⭐⭐⭐ 4,8/5 sur Google My Business. Vous aussi, partagez votre expérience !

Noter la formation

| 2 290€ HT / personne |

| 3 jours (21 heures) |

UNE QUESTION ? UN PROJET ? UN AUDIT DE CODE / D'INFRASTRUCTURE ?

Pour vos besoins d’expertise que vous ne trouvez nulle part ailleurs, n’hésitez pas à nous contacter.

ILS SE SONT FORMÉS CHEZ NOUS